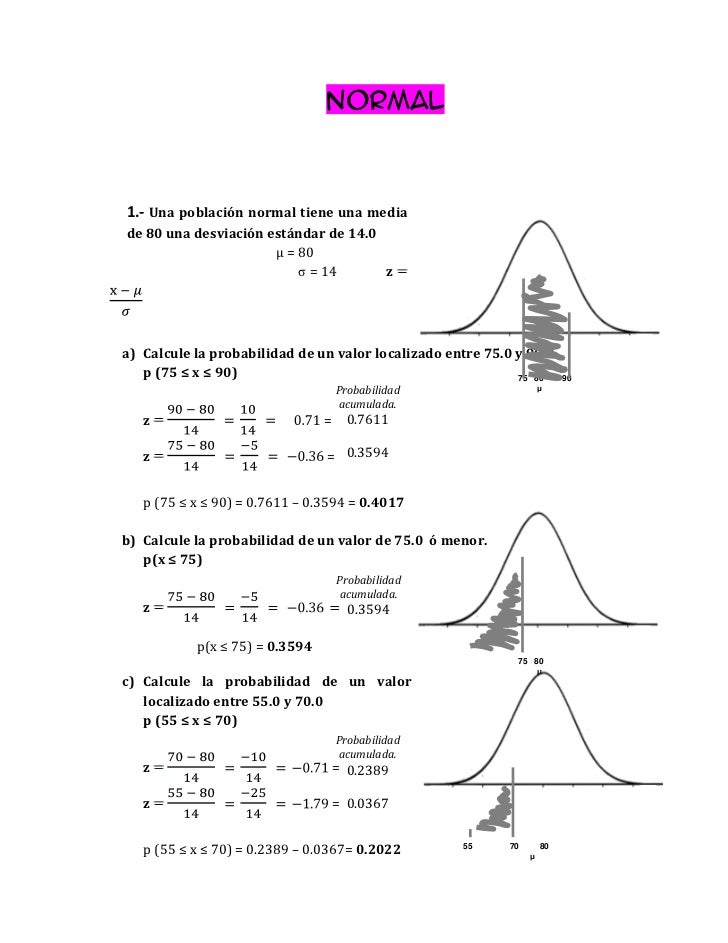

La distribución normal es

posiblemente la distribución de probabilidad más conocida y más aplicada en el

campo de la bioestadistica debido a que una gran cantidad muy grandes de

fenómenos reales pueden explicarse mediante este modelo de probabilidad.

La distribución normal debe su origen

al matemático francés Abraham De Moire, en 1733, y son figuras importantes en

su desarrollo histórico Pierre Laplace, en 1744, y Carl Gauss, en 1809 y 1816.

Es a través de este último que la distribución normal alcanzó mayor

notoriedad, ya que él la desarrollo como la “ley normal de los

errores de mediciones” particularmente en relación a observaciones

astronómicas”. La curva normal es ampliamente conocida como la curva de Gauss o

“Campana de Gauss”.

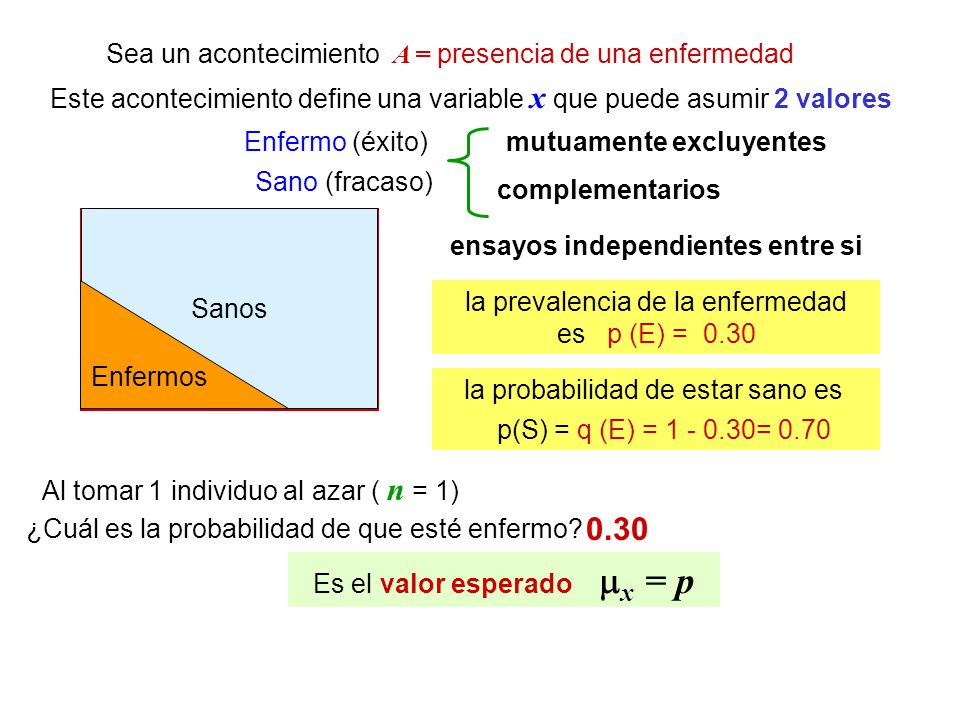

La importancia de la distribución

normal se debe, en primer lugar y como ya lo hemos dicho, a que muchas

variables siguen, aproximadamente, un modelo de probabilidad normal y esto ha

ocasionado que en las diferentes áreas del saber, su aplicación sea

generalizada en relación a este hecho hay que estar alerta y evitar incurrir en

el error de creer que todos los conjuntos de datos siguen una distribución

normal (enfermedades), cuestión a la que se tendían en el pasado. Actualmente

se conoce como una compleja variedad de casos donde el modelo normal resulta

inadecuado y deben tratarse utilizando otros tipos de distribuciones, de ser

asi seria erróneo el diagnostico o probabilidad de diferentes casos clínicos cuando

de salud estamos hablando.

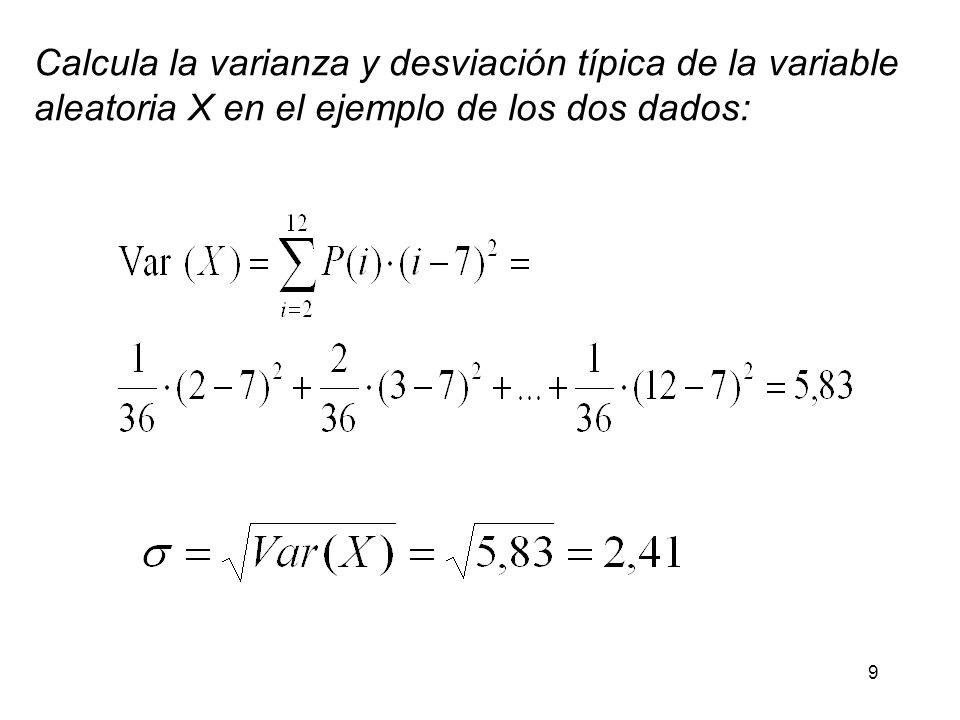

En segundo lugar, existe un resultado

muy importante con la distribución de normal conocido como Teorema

central de limite, El cual establece que para una muestra

suficientemente grande, la media muestral X¯¯¯ sigue una

distribución aproximadamente normal, independientemente del tipo de

distribución que tenga la población de la cual se extrae la muestra, en este

caso se engloban casos mas grandes como epidemias.